#112 Il vaut mieux s'occuper du changement avant qu'il s'occupe de vous !

Qui peut réellement profiter du potentiel de l’IA ?

Bonjour à toutes et tous,

Dans cette newsletter, vous trouverez un seul article concernant qui peut réellement profiter du potentiel de l’IA.

Stéphane

Qui peut réellement profiter du potentiel de l’IA ?

Pour écouter cette article avec un podcast réalisé par NotebookLM

Les conversations sur l’intelligence artificielle donnent souvent l’impression que le monde entier bascule déjà dans une ère entièrement automatisée. À écouter certains discours, chaque individu serait accompagné d’un coéquipier numérique, chaque entreprise fonctionnerait avec un cerveau algorithmique distribué et chaque marché se réorganiserait autour de modèles prédictifs. Les chiffres racontent une histoire plus lente, plus rugueuse et surtout beaucoup moins universelle. Une histoire faite de pertes successives, de ce que l’on pourrait appeler des fuites de valeur à chaque étage de la chaîne.

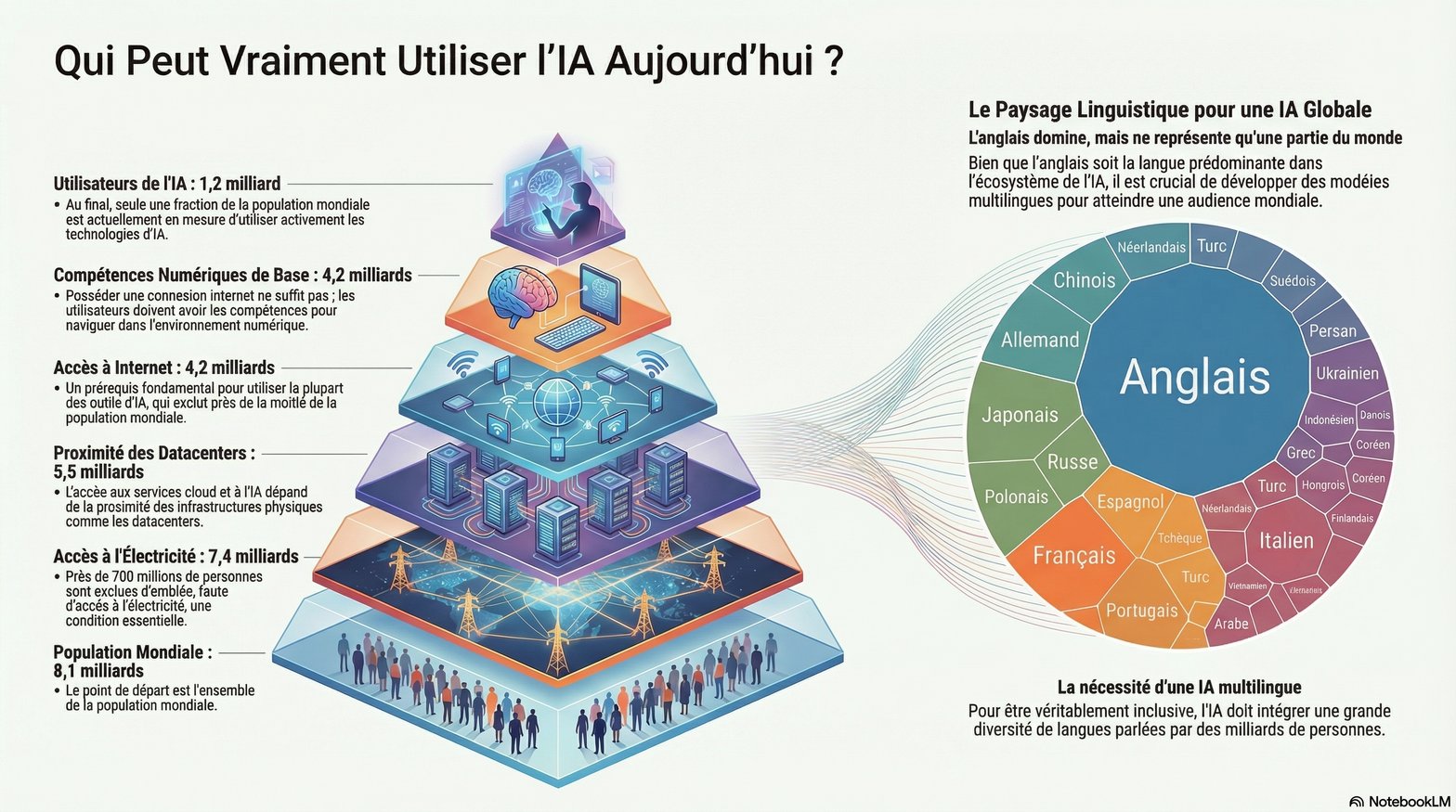

À la base, nous partîmes 8,1 milliards d’êtres humains et nous arrivâmes 1,2 milliard d’utilisateurs d’IA. Entre les deux, quatre filtres successifs où le potentiel annoncé se transforme en manque à gagner très concret pour les entreprises. Cette tribune est inspirée de la mise à jour du Microsoft-AI-Diffusion-Report https://www.microsoft.com/en-us/research/wp-content/uploads/2025/10/Microsoft-AI-Diffusion-Report.pdf. Elle propose d’expliquer les pertes successives et d’en ajouter une qui n’est pas dans le rapport. Celle où l’on perd encore davantage, non plus par manque d’accès ou de compétences, mais par mauvaise utilisation, y compris chez les utilisateurs les plus avancés.

Une pyramide de pertes successives

La population mondiale se situe autour de 8,1 milliards de personnes. Ce chiffre crée l’illusion d’un marché illimité pour les services numériques, dont l’IA serait le stade ultime. Pourtant, à chaque condition préalable, des centaines de millions d’individus disparaissent du champ d’action possible. Sans électricité, il n’y a ni smartphone, ni serveur, ni modèle de langage. Sur les 8,1 milliards d’êtres humains, 7,4 milliards disposent d’un accès à l’électricité. Autrement dit, environ 91% de la population. Les 700 millions restants ne se situent pas en marge symbolique. Ils forment un bloc humain équivalent à la population combinée de l’Union européenne et d’une grande puissance démographique supplémentaire. Ils vivent dans des zones où le simple fait d’allumer la lumière reste aléatoire. Ce premier filtre relève de l’ingénierie énergétique et des arbitrages géopolitiques. Pourtant il conditionne la diffusion effective de l’IA plus sûrement que n’importe quel plan de communication sur l’innovation.

Sur les 7,4 milliards de personnes disposant d’électricité, 5,5 milliards accèdent à Internet et aux datacenters associés. Environ 74% des individus électrifiés prennent donc pied dans l’économie en ligne. Il reste 1,9 milliard de personnes avec de la lumière mais sans réseau. Pour l’économie de l’IA, ce seuil constitue la première véritable rupture. Les modèles, les APIs, les services d’assistance reposent sur une disponibilité quasi permanente du réseau. Sans liaison stable, l’IA ne peut être un outil de travail mais seulement une curiosité intermittente.

Parmi les 5,5 milliards d’individus connectés, seuls 4,2 milliards maîtrisent les compétences numériques de base. On tombe alors à environ 52% de la population mondiale globale. Le troisième palier de perte est de 1,3 milliard de personnes. Elles ont un appareil, une connexion, parfois même une présence sur les réseaux sociaux sans disposer des compétences élémentaires qui transforment un outil en levier de productivité. Pour l’IA, ce déficit devient encore plus structurant. Une interface conversationnelle peut donner l’illusion d’une simplicité totale. Pourtant le gain réel dépend de la capacité à formuler une demande précise, à évaluer la qualité de la réponse, à l’intégrer dans un processus réel, ... Sans cette base, l’utilisateur reste spectateur d’une démonstration technologique. Ce delta de 1,3 milliard ne met pas seulement en lumière un défi éducatif. Il signale un surcoût direct pour les entreprises. Chaque euro investi dans des systèmes d’IA sans financement parallèle d’une montée en compétences génère une sous utilisation chronique. Dans certains groupes, elle se traduit par des taux de connexion inférieurs à 20 pour cent sur des logiciels pourtant présentés comme stratégiques.

Arrive ensuite le sommet actuel de la pyramide. Les utilisateurs d’IA au sens strict, c’est à dire les individus qui utilisent effectivement des outils s’appuyant sur l’intelligence artificielle pour produire, décider ou créer. Les données disponibles convergent vers un ordre de grandeur de 1,2 milliard de personnes. Ce chiffre ramène brutalement le discours sur une terre bien ferme. Sur 8,1 milliards d’êtres humains, environ 15% seulement se situent aujourd’hui dans une relation active avec l’IA. Cela ne signifie pas que les autres ignorent son existence. Cela signifie qu’ils ne l’utilisent pas de manière régulière et structurante.

La comparaison avec les 4,2 milliards de personnes dotées de compétences numériques de base met en évidence l’écart le plus intéressant en termes de potentialité. On observe un fossé de 3 milliards d’individus qui savent déjà utiliser des outils numériques classiques mais qui n’ont pas encore franchi le seuil de l’IA. Pour un dirigeant, c’est le cœur du sujet. Le marché immédiat ne se trouve pas dans les 8,1 milliards. Il ne se situe même plus dans les 5,5 milliards connectés. Il se niche dans ces 3 milliards de personnes qui pourraient devenir des utilisateurs d’IA sans nécessité de transformation profonde, mais qui ne l’ont pas encore fait.

Transformer la pyramide en plan d’action

Face à cette architecture de pertes successives, la tentation consiste parfois à hausser les épaules. Trop complexe, trop lointain ou encore trop macro. La clé consiste à accepter une idée simple. La technologie ne rattrapera pas spontanément les écarts. Sans intervention ciblée, la pyramide ne se redressera pas d’elle-même. Elle va au contraire se rigidifier.

Investir dans l’infrastructure plutôt que dans le seul discours : dans les zones où l’accès à Internet n’existe pas malgré l’électricité, une entreprise qui veut réellement faire de l’IA un levier de compétitivité doit intégrer le coût de la connectivité dans son modèle. Le discours sur la transformation numérique repose souvent sur l’idée que l’infrastructure suivra. La réalité est plus brutale. Sans alignement explicite entre politique d’investissement et carte réelle de la connectivité, l’IA reste un discours de siège social.

Traiter la formation comme une ligne de Capex stratégique : le troisième filtre, celui des compétences de base, relève classiquement de l’éducation publique. Les entreprises ont longtemps considéré que la littératie numérique élémentaire arrivait toute faite avec les nouvelles générations. Cette hypothèse ne tient plus. Transformer un salarié doté de compétences numériques de base en utilisateur efficace d’IA exige un effort structuré. Cela ne se résume pas à une vidéo d’onboarding ou à un tutoriel en ligne. Il s’agit d’un changement de posture intellectuelle. Passer d’un rapport de simple exécution des consignes logicielles à une capacité de dialogue critique avec un système probabiliste. La direction des ressources humaines et la direction de la transformation devraient donc considérer cette montée en compétence comme une catégorie d’investissement à part entière. Une IA sans dispositif de formation avancé ressemble à une machine de précision laissée dans son emballage.

Concevoir des produits d’IA supportables par des utilisateurs réels : la plupart des discours produit autour de l’IA mettent en avant la sophistication des modèles, la taille des paramètres, la quantité de données, ... Pour convertir les 3 milliards d’utilisateurs au seuil, un autre critère devient décisif à savoir le coût cognitif d’utilisation. Un outil d’IA générative capable de rédiger un contrat complexe ou de traduire un rapport technique dans dix langues ne crée de valeur que si le collaborateur peut l’appeler, comprendre sa logique et vérifier son contenu sans surcharge mentale excessive. Autrement dit, l’interface, l’intégration dans les outils existants et le niveau de guidage contextuel importent autant que le modèle lui-même. Cela déterminera la vitesse de conversion des utilisateurs dotés de compétences de base vers un usage quotidien. La conquête des 3 milliards ne passe pas par plus de puissance mais par moins de friction.

La couche linguistique, ou l’art de rater un marché pour une nuance

L’autre filtre rarement chiffré est linguistique. Les modèles de langage deviennent la face visible de l’IA. Ils structurent la relation utilisateur pourtant leur couverture linguistique réelle reste incomplète. Une IA qui fonctionne à un niveau quasi natif en anglais mais approximatif en vietnamien, en hongrois ou en roumain crée un biais structurel. Elle favorise mécaniquement les marchés où l’anglais est présent, ne serait-ce que comme langue de travail secondaire. Elle ralentit l’adoption ailleurs. Pour une entreprise mondiale, la question touche directement la productivité marginale de l’outil. Un service client en polonais qui s’appuie sur un modèle mal entraîné voit son temps de traitement augmenter, son taux de résolution baisser et au passage son risque juridique croître. Le même outil affichera des performances spectaculaires en anglais pour les démonstrations au conseil. Ce décalage crée un effet pervers. Le siège a l’impression d’avoir livré un outil de pointe tandis que les filiales considèrent qu’on leur a fourni un produit de seconde zone. L’écart d’usage s’installe et vient alimenter l’attrition globale. Intégrer la dimension linguistique dans la feuille de route IA revient à décider clairement dans quelles langues l’entreprise souhaite atteindre un niveau de performance algorithmique équivalent à celui de l’anglais. C’est aussi accepter que ce choix conditionne la carte réelle des gains de productivité dans les cinq prochaines années.

Le véritable coût de l’inaction

À ce stade, le constat peut sembler sévère. Pourtant l’inaction ne laisse pas les choses en l’état. Elle crée un décalage croissant entre les entreprises qui traitent sérieusement cette pyramide et celles qui se contentent d’un discours. Les premières vont concentrer une part croissante de la valeur parce qu’elles travaillent les quatre étages simultanément en participant à des projets d’infrastructure, en investissant dans des programmes de formation avancés, en concevant des produits d’IA adaptés au niveau réel de leurs équipes, en ajustant finement la couverture linguistique, ... Les autres se contentent d’empiler les annonces. Elles adoptent des outils en mode expérimental, sans cartographie des compétences, sans réflexion sur la réalité énergétique et réseau des pays clés et sans exigence forte sur la qualité linguistique. Elles accumulent les preuves de concept sans véritable passage à l’échelle.

Dans un cas, les chiffres de la pyramide deviennent progressivement une opportunité. Dans l’autre, ils se transforment en plafond de verre. On pourrait résumer ce différentiel de manière simple : les entreprises du premier groupe acceptent que leur stratégie IA se mesure d’abord en pourcentages de salariés formés et en part de revenus générés grâce à l’IA. Les entreprises du second groupe continuent à la mesurer en nombre de modèles testés.

Jusqu’ici, le raisonnement portait sur l’accès à l’IA. Pourtant un autre phénomène commence à peser autant sur la valeur créée. Même quand les quatre filtres sont franchis, même lorsqu’un individu dispose d’électricité, de connectivité, de compétences numériques de base et d’un outil d’IA opérationnel, la manière dont il l’utilise réduit souvent drastiquement le bénéfice réel. L’attrition se déplace à l’intérieur même des 1,2 milliard d’utilisateurs d’IA. Beaucoup d’utilisateurs se comportent avec l’IA comme avec un collègue idéal. Ils projettent sur le système des intentions, une forme de bon sens, parfois même une loyauté implicite. Ils l’installent mentalement dans la catégorie des êtres qui veulent bien faire.

“Un directeur marketing demande à un modèle de langage de proposer une stratégie pour un nouveau pays. Il lit la réponse comme il lirait le mémo d’un consultant junior. Il y voit une intention cohérente, un fil narratif, un point de vue. Il oublie que le système ne possède ni perception de la réalité locale, ni responsabilité sur le résultat.”

Ce réflexe anthropomorphique est loin d’être anodin car il abaisse brutalement le niveau de vigilance. Là où l’on aurait interrogé un collaborateur humain, demandé des sources, contesté certains chiffres, on se contente trop souvent d’un copier-coller à peine retouché. L’utilisateur croit gagner du temps alors qu’en réalité, il perd le contrôle du raisonnement. L’accès à un modèle d’IA puissant donne l’illusion d’une diversité de points de vue. En pratique, beaucoup d’utilisateurs acceptent la première réponse comme une vérité raisonnable. Ils reformulent peu, interrogent rarement d’autres sources, ne confrontent pas les angles.

“Un responsable RH qui demande un plan de gestion des talents à l’IA obtient une réponse structurée, bien écrite, rassurante par sa cohérence apparente. S’il ne formule pas d’autres questions en tension avec la première, il adopte un cadre de réflexion unique, façonné par les données dominantes du modèle. Les spécificités disparaissent en arrière-plan.”

On observe alors une homogénéisation subtile des décisions. Des organisations très différentes finissent par appliquer des trames de politiques semblables parce que leurs cadres se sont alignés sur les mêmes suggestions générées. Ce phénomène crée de la conformité et en aucune façon un avantage concurrentiel. L’outil devient trop souvent un amplificateur de soi. L’utilisateur le nourrit avec ses propres idées, ses convictions, ses biais, puis reçoit en retour une version embellie, structurée, policée de ce qu’il pensait déjà et y voit une validation implicite.

“Un dirigeant demande au système d’argumenter en faveur d’une décision qu’il a déjà prise. Le modèle ne fait que livrer un raisonnement détaillé qui renforce sa position. À aucun moment l’échange ne génère de contradiction sérieuse. Le confort intellectuel augmente au contraire de la qualité de la décision.”

Dans ce cas, l’IA joue le rôle d’une chambre d’écho intérieure. Elle renforce les intuitions existantes au lieu de les éprouver. La valeur potentielle, qui résidait précisément dans la capacité à confronter une idée à une masse de données plus large, s’évapore dans ce jeu de miroir.

Enfin, une grande partie des utilisateurs ne dispose pas encore de grille d’évaluation adaptée aux réponses d’un système probabiliste. Ils cherchent une justesse binaire. Vrai ou faux. Exact ou erroné. Dès que la réponse semble plausible, la vérification s’arrête. Or l’IA requiert un autre type de regard. Une lecture qui repère les angles morts, les sur simplifications ou encore les contextes absents. Sans cette compétence critique, le gain de productivité immédiat se paie par une dilution lente de la qualité décisionnelle.

Si l’on additionne ces quatre biais, un paradoxe apparaît. Une partie du manque à gagner de l’économie de l’IA ne vient plus du fait que les individus n’y ont pas accès. Il provient de l’usage lui-même, à l’intérieur de la population déjà équipée. Pour un dirigeant, cela impose un changement de focale. Le sujet ne se limite plus à la diffusion de l’outil dans l’organisation. Il touche la manière dont les collaborateurs pensent avec l’outil. Former des utilisateurs d’IA ne revient pas seulement à leur apprendre des commandes. Cela signifie aussi déconstruire l’anthropomorphisme confortable, installer des réflexes de mise en contradiction, encourager la recherche active d’alternatives, réhabiliter la responsabilité individuelle dans la validation des contenus, ... On peut imaginer un nouvel indicateur comme la part de décisions importantes qui intègrent un dialogue critique avec l’IA plutôt qu’une acceptation passive de la première proposition. Dans une organisation qui maîtrise ce niveau, les 1,2 milliard d’utilisateurs mondiaux deviennent un réel bassin de performance. Dans les autres, ils alimentent un bruit de fond pseudo rationnel qui peut masquer longtemps des faiblesses profondes.

L’économie de l’IA n’est pas une vague uniforme qui recouvrirait la planète. C’est au contraire une série de seuils successifs. À chaque seuil, des milliards de personnes sortent du champ. À chaque seuil, des entreprises se donnent ou se retirent la possibilité de capter une part de la valeur créée. Il y a d’abord les 700 millions de personnes encore privées d’électricité stable. Puis les 1,9 milliard qui ont la lumière mais pas le réseau. Puis les 1,3 milliard qui naviguent en ligne sans compétences vraiment productives. Puis les 3 milliards qui savent utiliser le numérique mais n’ont pas encore intégré l’IA dans leur travail. Enfin, au sommet actuel, les 1,2 milliard d’utilisateurs d’IA dont une partie importante réduit la valeur de l’outil par des usages peu critiques.

Pour un dirigeant, la question devient très concrète : où votre entreprise se situe-t-elle réellement dans cette pyramide ? Combien de vos collaborateurs relèvent encore de l’étage des compétences de base ? Quelle proportion se trouve au niveau des utilisateurs d’IA actifs ? Quel pourcentage adopte une posture critique plutôt qu’une confiance automatique ?

L’IA ne devient un avantage compétitif que lorsqu’elle se combine à trois éléments. Une infrastructure réelle, un capital humain formé à la fois aux outils et à la pensée critique et une culture d’usage qui refuse l’anthropomorphisme et la pensée unique. Tout le reste n’est que décor. L’enjeu n’est surtout pas de rendre les machines plus impressionnantes. Il est de faire en sorte que les humains, à travers elles, deviennent réellement plus lucides. Autrement dit, l’IA ne sera une force de métamorphose positive que si nous assumons de la traiter comme un prolongement du vivant plutôt que comme une entité supérieure à laquelle nous déléguons nos choix.

Bonnes Métamorphoses et à la semaine prochaine.

Stéphane