#125 : Il vaut mieux s'occuper du changement avant qu'il s'occupe de vous !

Sweetpea, le pari d'OpenAI pour remplacer le smartphone et conquérir notre quotidien Anthropic de la résistance à l’attaque Addiction numérique : L’heure de la responsabilité a sonné pour les géants de la technologie L'inflation des superlatifs

Bonjour à toutes et tous,

Et si l’époque changeait enfin de camp ?

Dans ce nouveau numéro de Métamorphoses 125, j’ouvre par un séisme judiciaire. Les géants des réseaux sociaux sont attaqués pour design même de leurs plateformes. Défilement infini, autoplay, boucles dopaminergiques : l’architecture de l’addiction entre au tribunal. Il s’agit d’un possible moment “Big Tobacco” pour la tech.

Je m’arrête ensuite sur un symptôme plus discret : l’inflation des superlatifs autour de l’IA. De “forte” à “super”, puis “hyper”… Quand le langage s’emballe, c’est souvent que la pensée hésite. Diviniser ou minimiser l’IA évite la vraie question. Que devient l’humain quand sa singularité cognitive vacille ?

Puis cap sur Sweetpea, le pari matériel d’OpenAI avec Jony Ive qui consiste à remplacer l’écran par la voix, conquérir notre quotidien et in fine sortir de la dépendance à Apple et Google. Vision révolutionnaire ou futur gadget de plus ?

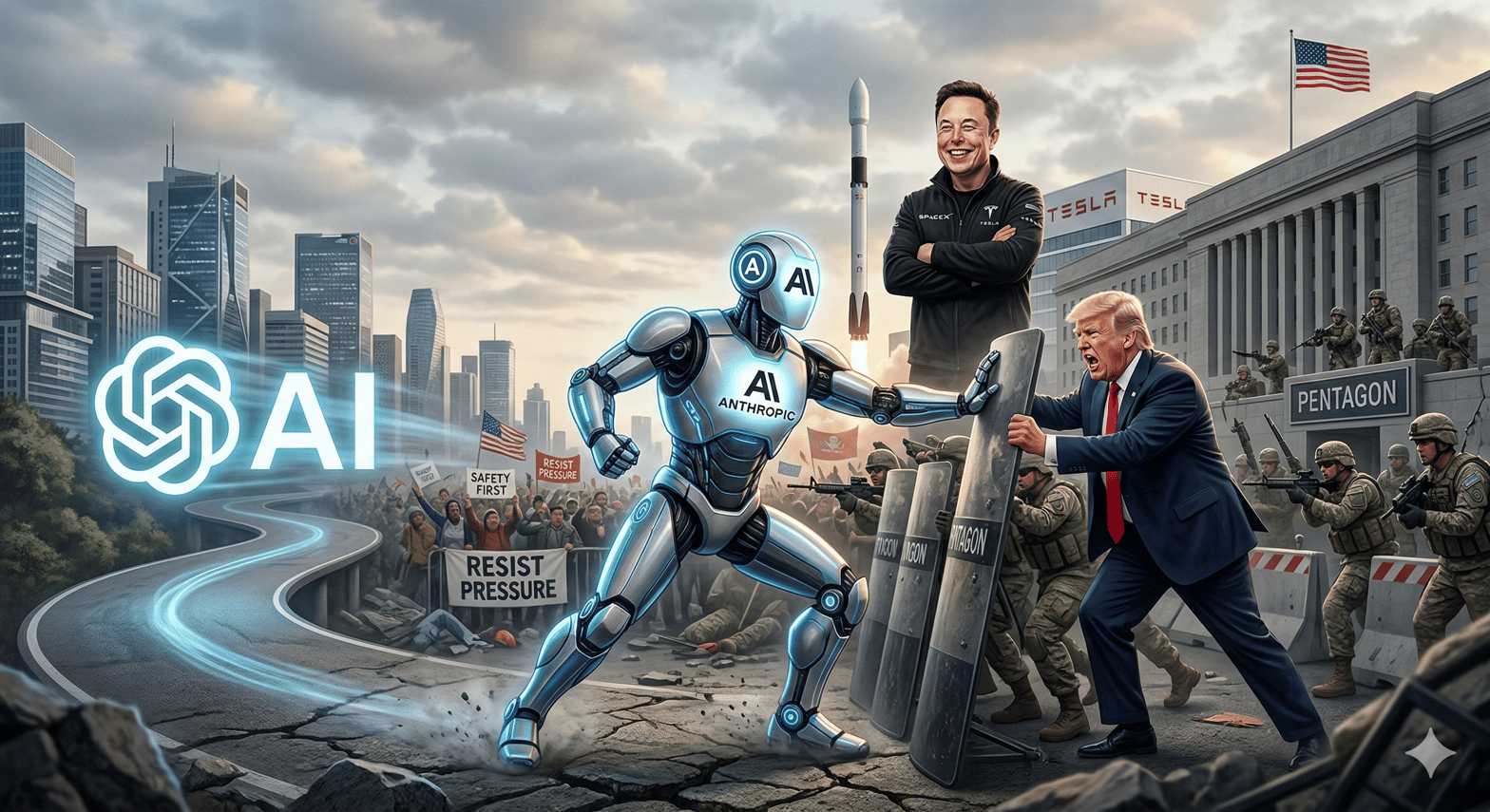

Enfin, Anthropic : tensions avec la Chine, bras de fer éthique avec le Pentagone, onde de choc jusqu’à IBM. L’IA est un enjeu stratégique, économique et moral.

Bonne lecture.

Stéphane Amarsy

Vous pouvez retrouver cette newsletter en podcast ici

Sweetpea, le pari d'OpenAI pour remplacer le smartphone et conquérir notre quotidien

Depuis le lancement de ChatGPT, OpenAI a dominé le paysage des logiciels d'intelligence artificielle. Pourtant, son ambition va bien au-delà de nos usages quotidiens. L'entreprise dirigée par Sam Altman s'apprête à faire le saut certainement le plus périlleux de sa courte histoire. Cela consiste à ajouter le monde matériel à celui du logiciel. Au cœur de cette métamorphose se trouve un projet ultra-secret répondant au nom de code "Sweetpea" qui est parfois également associé au nom commercial "Dime". Il s'agit d'une tentative de redéfinir fondamentalement notre interaction avec les machines.

Sweetpea n'est ni un smartphone, ni une montre connectée, mais un dispositif audio portable de nouvelle génération qui se loge dans vos oreilles. Conçu en collaboration avec le légendaire designer Jony Ive (le père de l'iPhone), l'appareil se démarquerait par un design premium en métal en forme de galet ("eggstone"), avec des capsules qui se placeraient derrière l'oreille, à la manière de certaines aides auditives haut de gamme. Technologiquement, Sweetpea serait propulsé par une puce gravée en 2 nanomètres (potentiellement dérivée de l'architecture Exynos de Samsung), dotant l'appareil d'une puissance de calcul de classe smartphone. L'objectif est de remplacer l'écran par la voix et l'audition, pour créer un assistant personnel proactif, conscient du contexte et capable d'interagir sans latence. Pour le décrire, Sam Altman utilise la métaphore d’un "cottage au bord d'un lac". Il parle d’une technologie apaisante qui tranche avec l'effet "Times Square" de nos smartphones actuels, qui bombardent et fragmentent notre attention.

La stratégie derrière Sweetpea est avant tout une question d'indépendance et de souveraineté écosystémique. Aujourd'hui, OpenAI dépend du bon vouloir d'Apple (iOS) et de Google (Android) pour distribuer ChatGPT sur les téléphones du monde entier. Pour ne pas rester un simple "locataire" sur les plateformes de ses rivaux, OpenAI veut posséder son propre point de contact matériel direct avec le consommateur final. Pour y parvenir, la société n'a pas hésité à sortir le carnet de chèques pour racheter io (fondée par Jony Ive et d'anciens vétérans d'Apple comme Tang Tan et Evans Hankey pour la somme colossale de 6,5 milliards de dollars) et une startup spécialisée dans l’échange entre nos cerveaux et les ordinateurs sans intrant matériel. En parallèle, sur le plan industriel, OpenAI opère également un virage géopolitique stratégique. L'entreprise a récemment retiré la production de son premier appareil au fabricant chinois Luxshare pour en confier l'exclusivité au taïwanais Foxconn. Ce choix vise à anticiper les tensions géopolitiques et à rassurer sur la sécurité matérielle de ses dispositifs. Enfin, Sweetpea n'est que la première brique d'un vaste écosystème matériel. OpenAI prépare également une enceinte intelligente avec caméra intégrée (prévue pour début 2027) capable de reconnaissance faciale pour les paiements, ainsi que des lunettes intelligentes et un stylo dopé à l'IA ("Gumdrop").

Les défis qui attendent Sweetpea sont titanesques.

L'obstacle de la vie privée et de la cybersécurité : Un appareil pensé pour être "toujours à l'écoute" (always-on) provoque de légitimes inquiétudes en matière de surveillance et de captation de données privées. Le fantôme du scandale de la vie privée plane sur tout appareil ambiant. La réponse d'OpenAI réside dans sa puce 2nm : en traitant l'intelligence artificielle localement (Edge AI) plutôt que dans le cloud, l'entreprise promet des temps de réponse instantanés (sans l'interruption du réseau) tout en garantissant qu'aucune donnée vocale sensible ne quitte l'appareil.

Le défi de l'usage : Les tentatives récentes de créer des "tueurs de smartphones" basés sur l'IA (comme le Humane AI Pin ou le Rabbit R1) se sont soldées par des échecs cuisants, minés par des latences insupportables et une utilité discutable. Sweetpea devra prouver qu'il n'est pas qu'un gadget et que l'abandon de l'écran apporte une réelle plus-value au quotidien.

Une concurrence féroce : OpenAI entre sur un marché où les géants ont déjà pris de l'avance. Apple accélère le développement de ses propres dispositifs portables (projet N50 pour des lunettes audio et AirPods avec caméras), tandis que Meta connaît déjà un succès croissant avec ses lunettes Ray-Ban intelligentes.

Si OpenAI et Jony Ive réussissent à résoudre l'équation complexe de la latence, de la confidentialité et du design, ils pourraient bien inaugurer l'ère de l'informatique post-smartphone. Dans le cas contraire, Sweetpea rejoindra le cimetière des prototypes trop ambitieux qui ont sous-estimé l'attachement indéfectible des humains à leurs écrans.

Anthropic de la résistance à l’attaque

Guerre technologique avec la Chine, accusée de pillage industriel, conflit éthique avec le Pentagone sur les conditions de l’enlèvement du président vénézuélien Nicolas Maduro, disruption de pans entiers de l’économie, y compris de la vénérable IBM, qui a perdu plus de 13 % en Bourse en une séance. Lundi 23 février 2026, la start-up Anthropic, qui a inventé le modèle Claude, faisait la une sur trois sujets majeurs.

La firme, fondée en 2021 par des dissidents d’OpenAI et valorisée à 380 milliards de dollars, est devenue l’épicentre de la révolution mondiale de l’intelligence artificielle (IA). En publiant, fin janvier, une longue réflexion sur les risques de cette technologie, son PDG et fondateur, Dario Amodei, avait préparé le terrain aux immenses soubresauts que son entreprise allait rapidement provoquer et aux débats fondamentaux dans lesquels elle allait être impliquée. On y est. A quelques semaines de la visite d’Etat du président américain, Donald Trump, en Chine, Anthropic a accusé, lundi, ses concurrentes chinoises de siphonner ses données pour entraîner leurs propres modèles. « Nous avons identifié des campagnes à grande échelle menées par trois laboratoires d’IA (DeepSeek, Moonshot et MiniMax) visant à extraire illégalement les capacités de Claude afin d’améliorer leurs propres modèles », accuse la start-up dans un communiqué. Ces laboratoires ont généré plus de 16 millions d’échanges avec Claude, au moyen d’environ 24 000 comptes frauduleux, précise la firme. Elle explique qu’ils « ont utilisé une technique appelée “distillation”, qui consiste à entraîner un modèle moins performant sur les résultats d’un autre plus puissant ». « Ces campagnes gagnent en intensité et en sophistication. Il est urgent d’agir », écrit l’entreprise de Dario Amodei, qui estime qu’« une action rapide et coordonnée des acteurs du secteur, des décideurs politiques et de la communauté mondiale de l’IA est indispensable ».

L’accusation publique intervient dix jours après celle d’OpenAI faite dans le cadre d’une note adressée à la commission de la Chambre des représentants des Etats-Unis sur la Chine. L’entreprise de Sam Altman y estimait que DeepSeek avait utilisé ces techniques de distillation dans le cadre de ses « efforts continus pour exploiter indûment les capacités développées par OpenAI et d’autres laboratoires de recherche américains de pointe ». Et OpenAI disait avoir détecté de « nouvelles méthodes d’obscurcissement » conçues pour contourner ses mesures de protection contre l’utilisation abusive des résultats de ses modèles. L’entreprise avait commencé à exprimer en privé ses inquiétudes concernant cette pratique et à enquêter, avec son partenaire Microsoft, peu après la publication du modèle R1, de DeepSeek, en janvier 2025. Ce lancement avait traumatisé la tech américaine et fut comparé avec le « moment Spoutnik », lorsque la Russie soviétique avait humilié les Etats-Unis en envoyant en premier un satellite dans l’espace, en 1957. En janvier 2025, les Chinois ont présenté un modèle plus performant et moins énergivore que ceux des Américains, provoquant une chute de Wall Street.

Immédiatement, Dario Amodei s’était montré très strict vis-à-vis de la Chine, partisan de « contrôles à l’exportation rigoureusement appliqués » : « Si la Chine ne parvient pas à se procurer les millions de puces [dont elle a besoin], nous vivrons (au moins temporairement) dans un monde unipolaire, où seuls les Etats-Unis et leurs alliés posséderont ces modèles… et pourraient ainsi exercer une domination mondiale incontestable et durable », écrivait-il alors. Depuis, les Américains sont repartis pour une fringale d’investissements, mais la tension remonte, alors que DeepSeek s’apprête à lancer son modèle de nouvelle génération. Un second « moment Deepseek » pourrait faire éclater la bulle, qui a déjà commencé à se dégonfler donc autant éviter la concurrence chinoise.

Lundi, Anthropic a insisté sur les risques induits par le pillage des données par les entreprises chinoises pour la sécurité nationale. « Les laboratoires étrangers qui s’inspirent des modèles américains peuvent ensuite intégrer ces capacités non protégées dans les systèmes militaires, de renseignement et de surveillance, permettant ainsi aux gouvernements autoritaires de déployer une IA de pointe pour des cyberopérations offensives, des campagnes de désinformation et la surveillance de masse », accuse la firme.

Cet accent sur la sécurité nationale est mis en valeur, alors que, sur la scène politique intérieure, Anthropic est dans le collimateur de l’administration Trump, qui lui reproche d’avoir des scrupules. Dario Amodei est convoqué, mardi au Pentagone, par le secrétaire à la défense, Pete Hegseth, a révélé le site d’information Axios. En cause, l’usage d’Anthropic par le ministère, renforcé par un contrat de 200 millions de dollars à l’été 2025. La capture de Nicolas Maduro, le 3 janvier, a cristallisé les tensions. Pour cette opération, le Pentagone a utilisé Claude, à travers les programmes de Palantir, la firme qui avait aidé à la capture d’Oussama Ben Laden, a révélé The Wall Street Journal, le 15 février. Le détail de l’usage du modèle d’Anthropic sur le terrain n’a pas été confirmé, secret défense oblige, mais, selon la presse américaine, la firme a posé des questions. Furieux de ces hésitations éthiques, le Pentagone a menacé d’annuler le contrat, tandis que, dès janvier, Pete Hegseth a déclaré, visant Anthropic, que l’agence n’utiliserait pas « de modèles d’IA qui empêcheraient de faire la guerre ». Toujours selon Axios, l’administration Trump est furieuse contre Dario Amodei qu’ils accusent de « wokisme ». Celui-ci ne veut pas lever complètement ses restrictions à l’utilisation de Claude, notamment l’usage létal sans la présence d’humains et la surveillance des Américains.

L’ennui, c’est que Claude est le seul modèle d’IA disponible dans les systèmes classifiés de l’armée, et le plus performant pour les missions sensibles de défense et de renseignement. Toujours selon Axios, Pete Hegseth prétend présenter un ultimatum à Anthropic, tandis que xAI, la firme d’IA d’Elon Musk, a, révèle The New York Times ce lundi, signé un accord avec le Pentagone et que Google serait sur le point de le faire. M. Amodei était très ferme fin janvier : « Il est impératif de limiter l’utilisation de l’IA par nos gouvernements afin d’éviter toute prise de pouvoir ou répression de leur propre population. Selon moi, nous devrions utiliser l’IA pour la défense nationale dans tous les domaines, sauf ceux qui nous rapprocheraient de nos adversaires autocratiques. »

Un troisième séisme, d’ordre économique, s’est matérialisé ce lundi 22 février 2026 avec l’effondrement de 13,15 % d’IBM en Bourse. Explication : Anthropic estime avoir un moyen de moderniser les programmes écrits en Cobol, un langage inventé en 1959 mais très présent dans le traitement de données, notamment des banques, un domaine de spécialité d’IBM. La firme, qui dominait l’informatique au XXᵉ siècle, n’est qu’une victime de plus. L’entreprise de Dario Amodei traumatise la « vieille tech », comme on disait la « vieille économie » pendant la bulle Internet de la fin des années 1990, en présentant, jour après jour, des modèles susceptibles de bouleverser des pans entiers de l’économie. Ce furent, au début du mois de février, les entreprises de logiciels, puis celles de services juridiques, suivies par les sociétés de cybersécurité, le 20 février.

Dario Amodei conclu ainsi son essai, publié en janvier : « Les années à venir seront d’une difficulté extrême, exigeant de nous bien plus que nous ne pensons pouvoir donner. Mais même confrontée aux circonstances les plus sombres, j’espère que l’humanité trouvera la capacité de rassembler, apparemment à la dernière minute, la force et la sagesse nécessaires pour triompher. Nous n’avons pas une seconde à perdre. »

A suivre …

Retrouvez tous nos livres ici ou dans vos librairies préférées.

Addiction numérique : L’heure de la responsabilité a sonné pour les géants de la technologie

L’ère de l’impunité numérique et de l'insouciance technologique touche à sa fin. Devant les tribunaux de Californie et dans plus d'une quarantaine d'États américains, une bataille juridique d'une ampleur inédite est en train de redéfinir notre relation avec les géants du web. Sur le banc des accusés, des entreprises tentaculaires comme Meta (Facebook, Instagram), Google (YouTube), TikTok et Snapchat font face à de multiples plaintes les accusant d’avoir sciemment conçu des produits addictifs au détriment direct de la santé mentale des enfants et des adolescents. ENFIN ! Il est grand temps de dissiper le mythe persistant de la "plateforme neutre". Les réseaux sociaux ne sont plus de simples hébergeurs de contenus, mais des produits dont l'architecture même est délibérément fabriquée pour captiver, manipuler et rendre dépendant.

Pour comprendre l'ampleur et la gravité de cette crise, il faut soulever le capot de ces applications et observer les mécaniques qui s'y cachent. Les ingénieurs de la Silicon Valley ne se sont pas contentés de créer des espaces virtuels d'échange sociaux. Ils ont méthodiquement emprunté les techniques de "conditionnement opérant" développées par la psychologie comportementale, des méthodes qui sont d'ailleurs largement exploitées par l'industrie des jeux d'argent et des casinos. Des fonctionnalités redoutables telles que le défilement infini (infinite scroll), la lecture automatique (autoplay), et la distribution aléatoire et imprévisible de récompenses sous forme de "likes" ou de notifications, agissent sur le cerveau humain de la même manière qu'une machine à sous. Le Dr Anna Lembke, experte en psychiatrie à l'Université de Stanford, a d'ailleurs témoigné lors de récents procès que ces mécanismes déclenchent d'importants pics de dopamine qui court-circuitent la volonté et poussent à une utilisation compulsive. Le véritable but de ces plateformes n'est pas d'offrir une expérience utilisateur enrichissante, mais bien de maximiser ce qu'elles appellent "l'engagement". Le temps d'attention volé à nos jeunes et pas que est ensuite méticuleusement converti en revenus publicitaires, quitte à sacrifier l'équilibre psychologique d'une génération entière.

Les conséquences de ce piratage cognitif sont dramatiques et désormais chiffrées. L'administrateur de la santé publique des États-Unis, le Dr Vivek Murthy, a officiellement qualifié la situation de véritable crise de santé publique. Ses avertissements sont clairs. Les jeunes qui passent plus de trois heures par jour sur ces plateformes voient leur risque de souffrir de dépression et d'anxiété doubler et l'on observe chez les utilisateurs les plus extrêmes des modifications de la structure cérébrale comparables à celles causées par la toxicomanie ou l'addiction aux jeux de hasard.

Pendant plus d'une décennie, l'industrie technologique s'est retranchée derrière un bouclier juridique que l'on pensait impénétrable qui est la Section 230 du Communications Decency Act de 1996 et le Premier Amendement de la Constitution américaine. Ces textes de loi protègent la liberté d'expression et immunisent les plateformes contre les poursuites liées aux contenus publiés par des tiers. Mais la stratégie juridique actuelle marque un changement de paradigme fondamental. Les plaignants contournent cette immunité en attaquant non pas le contenu (les vidéos extrêmes ou les messages nuisibles), mais le design et la conception du produit lui-même. L'analogie invoquée devant les tribunaux est limpide. On n'interdit pas une voiture parce qu'un individu conduit mal, mais on condamne fermement un constructeur automobile s'il a délibérément conçu un réservoir d'essence défectueux susceptible d'exploser. L'absence criante de vérification d'âge rigoureuse, les algorithmes de recommandation poussant au "doomscrolling" et les boucles de rétroaction toxiques constituent, selon cette approche, de graves défauts de conception inhérents au code même des applications. La justice commence d'ailleurs à valider cette distinction clé entre le contenu et l'outil. Par exemple, une cour d'appel fédérale a autorisé l'État de Floride à appliquer une loi interdisant la création de comptes sur les réseaux sociaux pour les enfants de moins de 14 ans. Les juges ont estimé que cette législation ciblait légitimement les éléments de "design addictif" sans violer la liberté d'expression, car réguler une fonctionnalité comme le défilement infini revient à réguler le fonctionnement d'un produit, et non ce que les utilisateurs y disent. Sur le plan du droit, le conditionnement psychologique imposé par une interface est considéré comme "neutre vis-à-vis du contenu" et ne doit donc plus pouvoir se cacher derrière le paravent de la liberté d'expression.

Ce réveil judiciaire et politique est légitimement comparé aux procès historiques qui ont fait tomber l'industrie du tabac dans les années 1990. La mécanique de l'omission est tristement identique. L'industrie savait, mais elle a sciemment choisi le silence au nom du profit. Les milliers de documents internes révélés en 2021 par la lanceuse d'alerte Frances Haugen l'ont prouvé sans l'ombre d'un doute. Meta avait mené ses propres études et savait pertinemment que ses plateformes, notamment Instagram, aggravaient les pensées suicidaires chez 13,5 % des adolescentes et les troubles du comportement alimentaire chez 17 % d'entre elles. Pourtant, face à l'évidence, les entreprises ont ignoré les solutions à leur portée. Des mesures simples et efficaces, comme la désactivation des notifications nocturnes pour préserver le sommeil des adolescents, ont été écartées par les instances dirigeantes parce qu'elles risquaient d'entraîner une baisse de l'engagement des utilisateurs, même infime. Le simple fait que Mark Zuckerberg, Adam Mosseri et d'autres grands patrons de la tech soient aujourd'hui appelés à la barre pour répondre de ces choix d'ingénierie implacables devant un jury populaire constitue une victoire historique pour la société civile. L'ère de la complaisance et du "faites-nous confiance" est bel et bien révolue et doit laisser place à l'ère de la transparence algorithmique.

Quelle est donc la voie à suivre face à cette crise ? Il ne s'agit évidemment pas d'abolir l'Internet ou de supprimer les réseaux sociaux, qui peuvent aussi offrir de formidables espaces de connexion, d'expression et de rassemblement. Il s'agit en revanche d'exiger une refonte éthique et d'imposer un devoir de vigilance inaliénable. Si un produit numérique est spécifiquement calibré pour être manipulateur et addictif de manière prévisible, ses créateurs doivent en répondre devant la loi. Ce mouvement civique et légal dépasse largement les frontières américaines. À travers le monde, la pression s'intensifie. L'Union européenne, avec l'entrée en vigueur de son règlement sur les services numériques (DSA), ou encore le Royaume-Uni avec l'Online Safety Act, obligent désormais les géants du numérique à évaluer et atténuer les risques systémiques que leurs algorithmes font peser sur les mineurs.

Nous devons collectivement exiger et soutenir la mise en place de mesures correctives réelles et non contournables. Le blocage du défilement infini pour les plus jeunes, la fin de la lecture automatique, une véritable vérification de l'âge, et, comme le suggère le Dr Murthy, l'apposition de messages d'avertissement sanitaires clairs sur ces applications, à l'instar de ceux figurant sur les paquets de cigarettes. Nos enfants ne sont pas de simples "ressources publicitaires" ou des "cerveaux disponibles" dont on peut extraire l'attention jusqu'à l'épuisement psychologique.

Cette offensive judiciaire est un impératif moral et non pas juste un passionnant débat de droit de la responsabilité. C'est le combat de notre époque pour préserver notre autonomie cognitive, protéger la santé mentale des générations futures et affirmer avec force face aux empires technologiques qu'aucun modèle économique n'est au-dessus de la santé publique.

Passons ensuite à l’IA …

L'inflation des superlatifs

Nous sommes passés de l'intelligence artificielle "forte" à "super", puis "hyper", et bientôt sans doute "ultra" ou "méta". Cette escalade sémantique ne dit pas tant la puissance croissante des algorithmes que notre propre désarroi face à ce qui nous échappe. Derrière chaque superlatif ajouté, il y a plus une révélation anthropologique qu'une révolution technique à savoir que nous ne savons plus nommer ce qui nous dépasse sans le magnifier jusqu'à l'hyperbole.

Quand le langage s'emballe, c'est souvent que la pensée tarde. Les superlatifs prolifèrent précisément là où la compréhension fait défaut. "Fort", "super", "hyper", cette surenchère lexicale trahit notre incapacité à saisir qualitativement ce qui se joue. Faute de pouvoir décrire avec précision les capacités émergentes des systèmes d'IA, nous empilons les adjectifs comme on monte une tour de Babel rhétorique et chaque étage censé nous rapprocher du ciel de la vérité nous éloigne un peu plus du sol de la réalité. Cette fuite en avant sémantique révèle un phénomène plus profond. Nous projetons sur l'IA nos propres fantasmes de toute-puissance. L'algorithme devient le réceptacle de nos rêves prométhéens et de nos terreurs existentielles. En le qualifiant d'"hyper-intelligent", nous lui attribuons une conscience, une intentionnalité et une transcendance qu'il n'a pas. Nous fabriquons nos propres démiurges.

Pourquoi faisons-nous cela ? Parce que l'être humain a toujours eu besoin de nommer ce qui le terrifie pour mieux le conjurer. Les Grecs avaient leurs Titans, le Moyen Âge ses dragons et nous avons nos "super-intelligences". Cette inflation des superlatifs est une forme moderne d'incantation. En grandissant démesurément l'objet de notre inquiétude, nous lui donnons une consistance mythologique qui, paradoxalement, nous rassure car un monstre nommé est un monstre circonscrit. Mais il y a plus. Cette escalade sémantique traduit aussi notre fascination pour notre propre créature. L'IA est le miroir le plus pur que l'humanité se soit jamais tendu. En elle, nous voyons notre intelligence décomposée, nos biais révélés, nos limites exposées, ... Et face à ce miroir troublant, nous oscillons entre deux postures également défensives : la minimisation ("ce n'est qu'un outil") ou la divinisation ("c'est une super-intelligence"). Les deux stratégies visent à maintenir une distance confortable. Les deux évitent le vrai sujet qui consiste à savoir ce que devient l'humain quand sa singularité cognitive n'est plus évidente ?

L'inflation des superlatifs signale la perte de notre capacité à mesurer avec justesse. Nous vivons dans une économie de l'attention où l'exagération est devenue la norme communicationnelle. Dire qu'une IA est "puissante" ne suffit plus à capter les regards saturés. Il faut qu'elle soit "super", puis "hyper", puis au-delà du langage lui-même. Cette course au superlatif est le symptôme d'une société qui a perdu le sens de la nuance, de la gradation et de la subtilité.

Bonnes métamorphoses et à la semaine prochaine.

Stéphane Amarsy