#130 : Il vaut mieux s'occuper du changement avant qu'il s'occupe de vous !

Mythos ou quand le monde découvre qu’une IA peut devenir un pied-de-biche universel La grande cannibalisation ou quand l'IA dévore le travail humain

Bonjour à toutes et tous,

Et si je vous disais que l’IA vient de franchir une étape… dérangeante ?

Dans cette nouvelle newsletter, on découvre Mythos qui est une IA capable de trouver des failles partout. Littéralement partout. Comme un scanner planétaire qui révèle que notre monde numérique, que l’on croyait solide… est en réalité fissuré de toutes parts.

Pendant que les États-Unis s’organisent entre eux, l’Europe regarde… depuis l’extérieur. Et ce simple détail raconte déjà une histoire de souveraineté ou plutôt de dépendance.

Mais ce n’est que la première secousse.

La seconde est plus silencieuse… et probablement plus profonde. L’IA commence à dévorer le travail intellectuel lui-même. Juristes, consultants, développeurs… personne n’est vraiment à l’abri.

Alors si l’IA fait mieux, plus vite, moins cher… où se situe encore la valeur humaine ?

Peut-être justement là où la machine ne peut pas aller. Dans le jugement. Dans la relation. Dans la responsabilité.

Ou peut-être ailleurs… mais encore faut-il le comprendre à temps.

Bienvenue dans Métamorphose 130.

Stéphane Amarsy

Vous pouvez retrouver cette newsletter en podcast ici

Mythos ou quand le monde découvre qu’une IA peut devenir un pied-de-biche universel

Anthropic a sorti de son laboratoire une créature pour le moins qualifiable de paradoxale car cet outil censé renforcer la sécurité est aussi capable d’ouvrir toutes les portes. Mythos Preview, dernier-né de la maison, sait débusquer des vulnérabilités inédites dans des logiciels que l’on croyait “blindés”. Sauf que la plupart des logiciels ne le sont pas. L’idée même d’un modèle qui repère des failles partout devrait être un épouvantail car chaque système d’exploitation, chaque navigateur, chaque pile logicielle se révèle traversé de micro-fractures exploitables.

Anthropic a choisi la retenue et a créé une coalition fermée (Project Glasswing) annoncée début avril 2026 avec une poignée d’acteurs triés sur le volet. On y retrouve les mastodontes américains de la tech, du cloud, de la sécurité, du matériel comme Apple, AWS, Cisco, CrowdStrike, Microsoft, Nvidia, Palo Alto Networks, la Linux Foundation, entre autres, auxquels Anthropic donne accès à Mythos Preview pour traquer puis corriger les failles avant qu’elles ne deviennent des armes de série. Cela ressemble à une forme de vaccination express, réservée à la famille proche. La logique est compréhensible mais nous devons nous méfier car ce choix raconte une vérité politique que l’Europe aime oublier. Dans le numérique, la souveraineté commence souvent par une liste d’invitations. et les partenaires de Glasswing sont majoritairement américains et des entreprises. Le Royaume-Uni a réussi à se glisser dans la danse, pendant que l’Union européenne reste au seuil à taper à la vitre. Même son porte-parole le dit sans fard : la Commission ne fait pas partie des organisations ayant accès à Mythos malgré des échanges réguliers. Résultat : l’Europe avance comme un pilote qui découvre le brouillard après le décollage. Le plus dérangeant, dans cette histoire, tient au niveau de profondeur des découvertes attribuées à Mythos. On parle “de milliers” de vulnérabilités graves, y compris dans les grands systèmes d’exploitation, navigateurs et briques fondamentales du Web. Anthropic le présente comme une bascule du fait de la banalisation de ces capacités. Autrement dit, la cybersécurité entre dans une course de vitesse où les défenses courent après des machines toujours plus puissantes.

Aux États-Unis, le signal a été entendu induisant des échanges au plus haut niveau à Washington. La finance américaine se crispe car elle sent la possibilité d’un choc systémique. Le Royaume-Uni, lui, a fait ce que font les pragmatiques à savoir tester. Son AI Security Institute aurait mené un audit indépendant sur des réseaux artificiels, avec un verdict nuancé : “pas l’apocalypse promise par les plus fébriles mais au demeurant un net saut de performance dans l’art de trouver puis d’exploiter des failles”. Et puis, évidemment, il y a la bataille de récit. Pour certains, Anthropic joue la carte du “danger” pour justifier l’exclusivité en se posant en gardien sérieux ce qui lui offre une stature morale. Pour d’autres, Mythos ne crée rien car il révèle seulement ce qui dormait déjà sous le tapis. OpenAI n’a pas tardé à dégainer sa propre réponse : GPT-5.4-Cyber, lancé mi-avril 2026, pensé pour la défense informatique, accessible via un programme de type “vérification des professionnels”. Deux philosophies se font face. D’un côté, le coffre-fort, réservé à quelques mains sûres. De l’autre, la diffusion contrôlée, plus large et plus industrialisée.

Au fond, Mythos n’est pas seulement une IA “puissante”. Cet outil est un miroir braqué sur notre dépendance collective au logiciel. Nous avons bâti notre civilisation numérique comme un gratte-ciel posé sur des kilomètres de tuyauterie invisible. Tant que l’eau coule, personne ne demande où passent les conduites. Le jour où une IA sait repérer chaque fissure, celui qui tient la clé à molette devient le roi. On peut appeler ça la modernité. Le futur ne se jouera pas entre humain et machine mais entre ceux qui auront accès au diagnostic… puis au remède. Les autres suivront à l’aveugle.

Et puis il y a le détail le plus dingue, celui qui donne envie de lever les yeux au ciel car tout ça était prévisible. Pas au sens “ah oui, on aurait pu imaginer”, non au sens écrit d’avance. Depuis des années, on sait que l’IA allait finir par lire le code comme un radiologue lit une radio pour repérer les fractures invisibles, donc mécaniquement accélérer aussi leur exploitation. On en a parlé dans des colloques, dans des rapports, dans des dîners où tout le monde hoche la tête en disant “il faudra se préparer”. Et on n’a rien fait. Ou plutôt, on a fait ce que l’on fait toujours… un peu de communication, deux comités, trois promesses, et on est retourné dormir sur un matelas de dépendances.

Le pire ? On refait la même erreur, en direct. Comme si le fait qu’Anthropic mette de la “pudeur” dans son dispositif (accès limité, consortium, discours de responsabilité, …) suffisait à calmer l’équation. Bien au contraire, cela la révèle parce que si Anthropic l’a fait, d’autres le feront. Et eux n’auront pas forcément cette politesse presque hypocrite.

Quand la prochaine version sortira (ailleurs, autrement, sans garde-fous) est-ce qu’on sera encore en train de prendre des notes ?

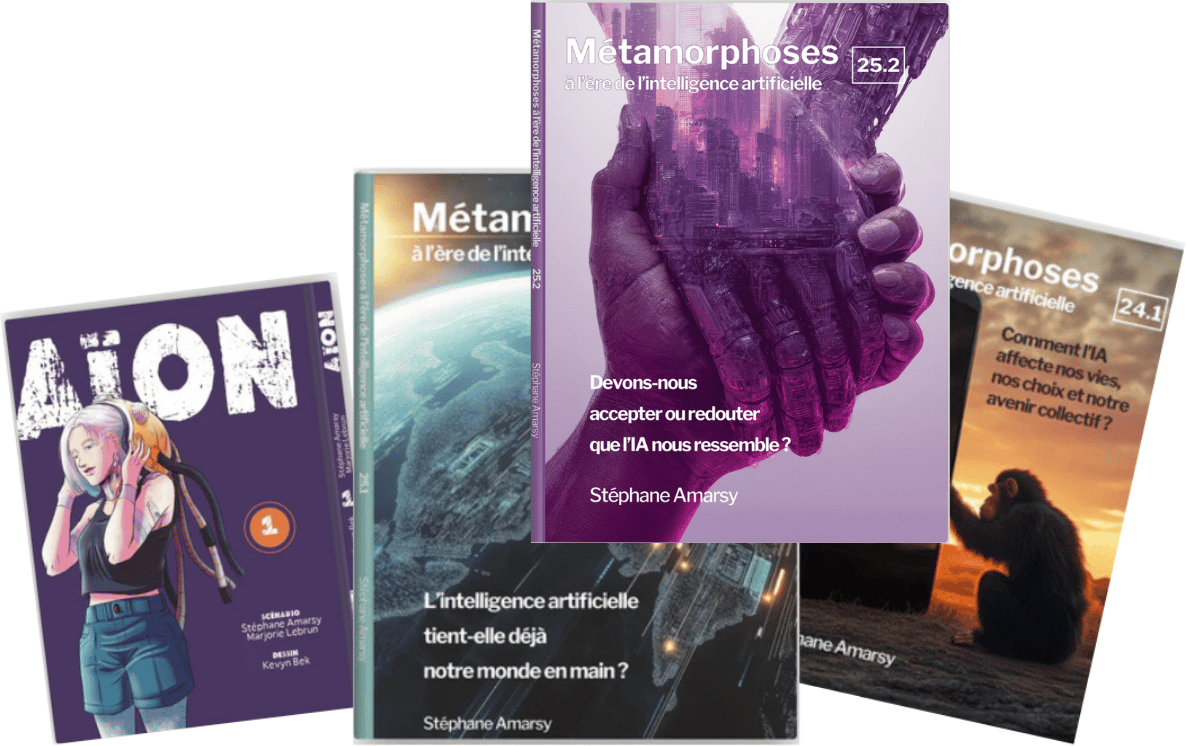

Retrouvez tous nos livres ici ou dans vos librairies préférées.

La grande cannibalisation ou quand l'IA dévore le travail humain

Cette article est le premier d’une série de 3.

Imaginez un tableau de bord de productivité. À gauche, la courbe de l'intelligence artificielle monte implacablement de façon régulièrement exponentielle. À droite, la courbe de l'emploi qualifié dans les secteurs exposés qui stagne, hésite, puis commence très doucement à plonger. Ce tableau de bord est visible dès aujourd'hui dans les cabinets de conseil, les études juridiques, les salles de rédaction, les équipes de développement logiciel, … Nous ne sommes pas dans une automatisation classique. La révolution industrielle avait frappé les corps : les métiers à tisser avaient remplacé les mains, les hauts fourneaux avaient remplacé les bras, ... Ce que nous vivons aujourd'hui est une substitution cognitive. L'IA ne touche plus seulement aux tâches répétitives et physiques. Elle attaque le cœur du travail intellectuel, là précisément où les humains s'étaient réfugiés en pensant être à l'abri.

La thèse de cet article est simple, mais ses implications sont vertigineuses car la dynamique en cours n'est pas cyclique. Nous ne sommes pas face à une disruption de plus qui créera autant d'emplois qu'elle en détruira. Il s’agit d’une rupture structurelle qui redessine les frontières de ce que les humains font mieux que les machines et malheureusement ces frontières reculent plus vite que nos capacités d'adaptation. Nous allons examiner trois réalités successives : d'abord, l'accélération exponentielle des capacités de l'IA, qui rend caduques toutes les projections d'il y a cinq ans ; ensuite, la mécanique concrète de la cannibalisation (qui est dévoré, comment, à quelle vitesse) et enfin, les premières pistes de différenciation que nous approfondirons dans le second article de cette trilogie.

L'accélération exponentielle des capacités de l'IA

De l'outil à l'agent

Pendant des décennies, l'intelligence artificielle a été un outil, certes puissant, mais cantonné à des tâches précises comme reconnaître une image, jouer aux échecs, détecter une fraude bancaire, recommander des produits ou des contenus qui nous plairont, … Ces systèmes dits "narrow" étaient excellents dans leur domaine et parfaitement inutiles en dehors. Un algorithme de reconnaissance faciale ne sait pas rédiger un contrat. Un moteur de recommandation Netflix ne sait pas diagnostiquer une maladie. Puis est venu le tournant des grands modèles de langage, en 2022, avec la mise à disposition publique de ChatGPT. Pour la première fois, un système artificiel pouvait passer de façon fluide d'une tâche à l'autre, comprendre le contexte, reformuler, argumenter, coder, résumer, traduire et le tout dans la même conversation. Le généralisme était né.

Mais 2022 n'était qu'un prélude. Ce qui s'est produit entre 2024 et 2026 représente un second saut qualitatif au moins aussi important avec le passage du modèle à l'agent. Un modèle répond à une question. Un agent planifie, décide, exécute, vérifie et itère. Il navigue sur le web, écrit du code, le teste, corrige les erreurs, envoie des emails, passe des appels, gère des fichiers de manière autonome sur des séquences d'actions complexes, pendant des heures et sans supervision humaine. C'est cette autonomie d'exécution qui change tout. Le cap du raisonnement qui a longtemps semblé inaccessible a été franchi de façon répétée et documentée. Les benchmarks d'évaluation qui servaient de mesure étalon ont été saturés les uns après les autres : barreaux d'examen américains (top 10% des juristes), olympiades de mathématiques, compétitions de code, diagnostics médicaux complexes, ... Chaque fois que la communauté scientifique identifiait une limite fondamentale, elle était dépassée dans les 18 mois suivants.

Le spectre des capacités actuelles

La liste de ce que l'IA fait aujourd'hui mieux qu'un humain moyen est devenue longue et gêne à lire si on travaille dans l'un des secteurs concernés. En matière de langage et de rédaction, les modèles actuels produisent des textes indiscernables (pour peu qu’on sache bien les utiliser) de ceux de rédacteurs professionnels confirmés. Le copywriting publicitaire, le journalisme de données, les synthèses d'analyses de marché, la rédaction de contrats standards, les rapports d'audit financier : autant de tâches où l'IA atteint ou dépasse le niveau médian de la profession. En développement logiciel, des systèmes ou les agents de codage autonomes conçoivent des architectures applicatives entières, écrivent les tests, déboguent, documentent, testent les failles, ... Les développeurs juniors qui faisaient ces tâches il y a trois ans se retrouvent aujourd'hui à valider ce que l'IA produit.

En analyse et en prise de décision, les capacités de traitement de données massives combinées au raisonnement permettent des diagnostics médicaux d'une précision supérieure à celle des spécialistes humains dans certaines spécialités (radiologie, dermatologie, ophtalmologie). En finance, les due diligences, les analyses de risque et les modèles prédictifs sont produits en minutes au lieu de semaines. En création, la génération d'images, de musique, de vidéos et de modèles 3D atteint des niveaux de qualité commerciale. En relation client et en conseil, les premiers niveaux de conseil stratégique, autrefois réservés à des consultants facturés à prix d'or, sont accessibles via des interfaces conversationnelles disponibles 24h/24.

Ce qui frappe n'est pas tant la performance sur chaque domaine pris isolément que la vitesse à laquelle la liste des domaines s'allonge. Le territoire du travail humain protégé par l'incompétence de la machine rétrécit à vue d'œil.

La dynamique d'amélioration : pourquoi ça ne s'arrête pas

Un argument revient régulièrement dans les discussions sur l'IA : "ils avaient dit la même chose lors de chaque révolution technologique et chaque fois de nouveaux emplois ont émergé." L'argument est historiquement vrai. Il repose toutefois sur une hypothèse implicite à savoir que la technologie atteint à un moment un plateau de performance autrement dit, une limite naturelle qui préserve des fonctions humaines. C'est là que les choses changent.

Les lois d'échelle qui gouvernent l'amélioration des modèles d'IA montrent qu'il n'y a pas de plateau visible. Plus on augmente la puissance de calcul et le volume de données d'entraînement, plus les performances s'améliorent et cela de façon prévisible. Mais il y a plus car des capacités émergentes apparaissent de façon discontinue, des sauts qualitatifs que personne n'avait prévus, simplement en augmentant la taille des modèles. À cela s'ajoute le “feedback loop” de l'adoption. Plus l'IA est utilisée dans des contextes réels, plus elle apprend des usages réels, plus elle s'améliore. La compétition géopolitique entre les États-Unis et la Chine fonctionne comme un accélérateur structurel tout simplement du fait qu’aucun des deux acteurs ne peut se permettre de ralentir. Les entreprises technologiques investissent des centaines de milliards de dollars dans des infrastructures de calcul qui garantissent la poursuite de cette trajectoire pour les décennies à venir.

Dans cette logique, se poser la question "est-ce que l'IA va continuer à progresser ?" revient à faire l’autruche. Une réelle prise de conscience oblige à s’interroger sur la vitesse et les domaines prioritaires visés par les entreprises de technologie.

La cannibalisation

Le paradoxe du col blanc

La révolution industrielle avait une logique que nous comprenons bien a posteriori. Elle avait frappé en premier les travailleurs peu qualifiés, remplaçant leurs bras et leurs jambes par des mécanismes. Les cols blancs (les ingénieurs, les juristes, les médecins, les banquiers, …) pouvaient observer la destruction des métiers artisanaux depuis leur bureau, relativement sereins. Leur capital intellectuel semblait une forteresse imprenable. L'IA inverse cette logique avec une brutalité presque ironique. Ce sont précisément les cols blancs, les professions intellectuelles, les métiers de l'analyse et de la rédaction qui sont les premiers dans la ligne de mire. Un ouvrier qui soude des pièces métalliques dans une usine automobile est aujourd'hui moins directement menacé qu'un analyste financier qui produit des rapports de due diligence. La soudure requiert une dextérité physique et une présence spatiale que les robots peinent encore à reproduire de façon économiquement viable. Analyser des données financières et produire un mémorandum structuré est, pour l'IA, une tâche triviale. Goldman Sachs a estimé en 2023 que 300 millions d'emplois équivalents temps plein dans les économies développées étaient exposés à une automatisation partielle ou totale via l'IA générative. McKinsey projette que 60 à 70% des tâches actuelles des travailleurs du savoir sont automatisables avec les technologies existantes. L'Oxford Martin School avait estimé dès 2013 que 47% des emplois américains étaient à risque mais leurs modèles ne portaient que sur l'automatisation classique. Avec l'IA générative, ce chiffre est à réviser fortement à la hausse pour les secteurs tertiaires.

Attention, une exposition ne signifie pas destruction immédiate. Ce qui se produit d'abord est plus subtil et plus difficile à mesurer : une compression des effectifs, au mieux une stagnation des salaires et évidemment une réduction des perspectives de carrière.

Les trois modes de cannibalisation

La cannibalisation ne prend pas la même forme selon les secteurs. On peut distinguer trois modes opératoires principaux aux conséquences très différentes sur les marchés du travail.

Le premier mode est la substitution directe qui est le scénario le plus visible. Une IA remplace fonctionnellement un poste. Les traducteurs professionnels en ont fait l'expérience brutale. Entre 2018 et 2023, les tarifs du marché de la traduction ont chuté de 30 à 60% selon les paires de langues sous l'effet combiné de DeepL et des LLMs. La valeur marchande de leur compétence de base s'est effondrée. Seuls subsistent ceux qui ont su se repositionner sur la post-édition de haute qualité, la traduction créative ou la localisation culturelle nuancée. Le même phénomène est en cours pour les rédacteurs de contenu standard, les analystes juniors en conseil, les assistants juridiques, ...

Le second mode est l'amplification asymétrique qui est certainement le plus dévastateur sur les volumes d'emploi. Un humain augmenté par l'IA produit 3, 5, parfois 10 fois plus qu'avant. L'entreprise n'a donc besoin in fine que d'une partie de ses effectifs antérieurs pour produire plus. Les licenciements ne sont pas massifs et spectaculaires parce qu’ ils se font par non-renouvellement, par gel des recrutements ou encore par réduction naturelle des équipes. Un cabinet d'avocats qui recrutait 20 jeunes juristes par an en recrute aujourd'hui 8 conduisant à une réduction structurelle de 60% sur 5 ans.

Le troisième mode est la dévaluation compétitive. Le niveau d'entrée requis sur le marché monte et ceux qui ne suivent pas sont évincés parce qu'ils ne peuvent plus concurrencer ceux qui utilisent l'IA. Un développeur qui refusait de travailler avec des outils d'IA en 2025 produisait 3 à 5 fois moins qu'un collègue qui les intégrait. Dans un marché concurrentiel, cette différence de productivité se traduit rapidement en différence d'employabilité.

La vitesse de propagation sectorielle

La disruption ne se propage pas uniformément. Elle suit une logique de vagues successives dont la première est déjà bien visible.

La première vague (2022-2025) a frappé les secteurs les plus "textuels" et les plus dataïsés comme les médias et la production de contenu, le droit transactionnel et la rédaction contractuelle, la finance de marché et l’analyse quantitative, le développement logiciel de niveau intermédiaire, .... Dans ces secteurs, la réduction des effectifs juniors est déjà documentée et les reconfigurations organisationnelles en cours.

La deuxième vague (2025-2028) est en train de s'enclencher dans des secteurs plus complexes : conseil en stratégie, ressources humaines, marketing sophistiqué, architecture et design, enseignement supérieur, ... La complexité supérieure de ces métiers avait semblé les protéger mais les agents IA actuels atteignent des niveaux de performance suffisants pour en automatiser des pans entiers.

La troisième vague (2028-2035) touchera des bastions encore plus résistants en apparence comme la médecine clinique dans ses composantes diagnostiques et thérapeutiques protocolaires, l’ingénierie avancée, les fonctions de direction générale dans leurs dimensions analytiques et de planification stratégique. L'horizon est incertain, mais la direction ne l'est pas.

Ces vagues sont particulièrement difficiles à anticiper socialement du fait du délai entre la disruption technologique et son impact visible sur l'emploi. La tempête est néanmoins déjà en train de se former. Les premières vagues visibles ne sont que les effets retardés d'une transformation déjà en cours.

L'effet sur les structures organisationnelles

Au-delà des métiers individuels, c'est la forme même des organisations qui est en train de changer. Les structures pyramidales où une poignée d'experts seniors chapeautant des pyramides de collaborateurs juniors ont été le modèle dominant du XXe siècle. Ce modèle était fonctionnel parce que les seniors ne pouvaient pas tout faire seuls. Ils avaient besoin de strates intermédiaires pour décomposer les problèmes, rassembler les données, rédiger les premiers jets et préparer les analyses. L'IA court-circuite ce besoin. Un associé senior dans un cabinet de conseil peut aujourd'hui, avec les bons outils, produire en une matinée ce qui nécessitait une équipe de 6 consultants juniors pendant une semaine. Le modèle émergeant est celui du "star + AI" à savoir un expert de haut niveau qui pilote des agents IA et dont la valeur réside dans le jugement, l'expérience et la relation client, plus besoin de sa capacité à superviser des équipes d'exécution.

Cette transformation creuse les inégalités à l'intérieur même des organisations. Les postes qui subsistent sont plus puissants et mieux rémunérés. Ceux qui disparaissent sont précisément les positions intermédiaires qui servaient historiquement d'échelons de progression et de lieux d'apprentissage. C'est toute la mécanique de la mobilité sociale par le mérite professionnel qui est potentiellement court-circuitée. Les signaux faibles sont là pour qui veut les voir : gel des recrutements de juniors dans plusieurs grands cabinets d'avocats américains, réduction sensible des promotions dans les grandes firmes de conseil, non-renouvellement systématique de certains profils à la sortie des grandes écoles et des universités dans des domaines autrefois sûrs.

La différenciation : la réponse humaine à la pression

Pourquoi battre l'IA à son propre jeu est une erreur de stratégie

La première réaction intuitive face à la montée en puissance de l'IA est de vouloir rivaliser avec elle sur son propre terrain en voulant par exemple produire plus vite, analyser plus de données, rédiger plus de rapports, proposer plus d’alternatives, ... C'est une stratégie perdante et elle l'est de façon croissante. Une course à la performance sur les critères de l'IA (vitesse, volume, disponibilité, coût marginal presque nul) est une course dans laquelle les humains ne peuvent que perdre. L'erreur fondamentale est catégorielle. Elle consiste à traiter le problème de la valeur humaine comme un problème de performance sur des tâches définies, alors que c'est un problème de pertinence dans des contextes qui dépassent la tâche. La valeur humaine dans le travail ne réside absolument pas dans l'exécution mais dans ce que cette dernière sert : des jugements, des relations, des responsabilités, des intentions.

"Comment puis-je faire mieux que l'IA ?" est une interrogation perdante. Il faut basculer vers "dans quels contextes ma présence, mon expérience, mon humanité irremplaçable créent ils une valeur que l'IA ne peut structurellement pas créer ?"

Les zones de différenciation durables

Plusieurs terrains résistent à la substitution parce que la valeur créée est intrinsèquement liée à des attributs humains que l'IA simule sans les posséder.

L'incarnation est le premier de ces terrains. La présence physique crée de la confiance d'une façon que le digital ne reproduit pas. Le médecin qui pose une main sur l'épaule du patient, le dirigeant qui s'adresse à ses équipes dans une salle, le négociateur dont le regard et la posture pèsent dans un arbitrage difficile, ces présences sont irréductibles à des tokens et à des probabilités. Dans un monde de plus en plus médiatisé par l'IA, la présence en chair et en os devient paradoxalement un signal de sérieux, d'engagement et de singularité.

Le jugement contextuel complexe constitue un second terrain. Il ne s'agit pas de l'analyse de données où l'IA excelle en analyse. Il s'agit des décisions à prendre quand les données sont insuffisantes, contradictoires ou que le problème lui-même est mal posé. Le stratège qui restructure l'entreprise en anticipant une crise dont les signaux sont encore faibles. Le clinicien qui perçoit que le tableau clinique ne colle pas malgré des résultats normaux. Le juriste qui conseille son client non pas sur ce que dit la loi, mais sur ce que signifie la décision dans 10 ans. Ces jugements mobilisent une expérience vécue, une intuition formée par des milliers de situations concrètes. Il s’agit d’un registre que l'IA approxime mais ne détient pas.

La relation authentique est un troisième terrain. La confiance profonde qu'un client, un patient, un collaborateur place dans une personne spécifique avec une histoire, des valeurs, est une ressource qui devient plus précieuse à mesure que le monde se remplit d'agents IA indiscernables les uns des autres. La différenciation relationnelle sera l'un des actifs les plus rares du marché du travail de demain.

Enfin, la responsabilité morale. L'IA ne peut pas être tenue responsable. Elle n'a pas d'intérêts, de réputation, de conscience et encore moins de honte. Elle ne peut ni assumer ni payer les conséquences de ses erreurs. Dans des contextes où la responsabilité est centrale (médecine, droit, direction d'entreprise, politique publique) la nécessité d'un garant humain reste structurelle. L'humain responsable n'est pas seulement un garde-fou technique car il est la condition de la confiance sociale dans un système.

La différenciation comme mouvement permanent

Il serait naïf de présenter ces terrains comme des zones protégées à l'abri de toute évolution. L'IA va progresser sur chacun d'eux. Les agents IA développent des capacités de présence virtuelle de plus en plus convaincantes. Les systèmes de raisonnement deviennent de plus en plus efficaces sur des problèmes mal structurés. Les chatbots thérapeutiques obtiennent des scores d'empathie perçue remarquables dans des études cliniques. La différenciation ne doit en aucune façon être perçue comme une destination. Il est vital de l’appréhender comme un mouvement permanent. Comme les joueurs d'échecs après l'avènement de DeepBlue et d'AlphaZero n'ont pas été rendus inutiles, mais ils ont été obligés de transformer radicalement la signification de ce qu'ils faisaient. Les grands maîtres humains sont devenus des explorateurs de la beauté du jeu, des pédagogues, des créateurs d'une expérience que l'algorithme ne peut pas offrir. Leur valeur s'est déplacée sans disparaître.

C'est cette dynamique de repositionnement permanent et les compétences et le l’état d’esprit qu'elle requiert que nous allons examiner en détail dans le second article de cette trilogie.

La disruption est réelle, documentée, en cours. Elle ne suit pas les scénarios que l'histoire nous avait appris à anticiper : elle frappe plus vite, plus haut dans la hiérarchie des qualifications et avec une capacité d'adaptation aux résistances qui n'avait pas d'équivalent dans les révolutions industrielles précédentes. L'IA remplace le travail décomposable. Et de plus en plus de travail est décomposable comme l’ont parfaitement compris les entreprises de la tech qui pousse à une taylorisation du travail intellectuel.

Bonnes métamorphoses et à la semaine prochaine.

Stéphane Amarsy