#126 : Il vaut mieux s'occuper du changement avant qu'il s'occupe de vous !

Quand la machine se nourrit de nos ombres

Bonjour à toutes & tous,

L’IA, on nous la vend comme une entité presque mystique. Une machine qui apprend seule. Qui pense. Qui s’améliore comme un organisme.

Et pourtant… si on gratte un peu le vernis, on tombe sur tout autre chose.

Dans la Métamorphoses n°126, je vous emmène derrière le rideau. Là où l’intelligence artificielle se construit vraiment : sur une armée d’humains invisibles, payés une misère, qui passent leurs journées à “apprendre” à la machine ce que nous ne voulons plus voir. Et sur un second carburant, encore plus intime : nos vies. Nos voix. Nos salons. Nos chambres. Nos silences.

Le paradoxe est violent : plus l’IA prétend à l’autonomie, plus elle dépend de nous.

La question “Sur quoi, sur qui, et à quel prix la fait-on tenir debout ? “ mérite des réponses parce qu’à force de nourrir la machine avec nos ombres… on finit par vivre dedans.

Bonne lecture ou écoute.

Stéphane Amarsy

Vous pouvez retrouver cette newsletter en podcast ici

Quand la machine se nourrit de nos ombres

L'intelligence artificielle nous est vendue comme l'avènement d'une conscience machinique autonome, un saut évolutif vers des algorithmes capables d'apprendre seuls, de penser par eux-mêmes, de se perfectionner organiquement à partir du vaste océan de la connaissance humaine. Ce récit, martelé par l'industrie technologique avec la constance d'un mantra, dessine les contours d'un futur radieux où la machine nous libérerait enfin du fardeau de la pensée répétitive, de l'erreur humaine et de nos propres limites cognitives. Pourtant, derrière cette façade soigneusement polie se dissimule une vérité d'une tout autre nature car elle est faite de chair meurtrie, de regards invisibilisés, de données arrachées à l'intimité de nos vies, … L'IA n'est pas cette entité éthérée et mystique que l'on nous dépeint. Elle est un système socio-technique tentaculaire dont les fondations reposent sur deux piliers aussi solides qu'inavouables : l'exploitation systémique d'une main-d'œuvre précaire dispersée aux quatre coins du monde et la surveillance de masse de nos existences les plus intimes.

Levons le voile sur ce mirage technologique parce que la lucidité est la première condition de la responsabilité. Le moment est venu d'interroger les fondements réels de cette révolution algorithmique et de confronter l'industrie à ses propres contradictions. Car si nous voulons construire une intelligence artificielle véritablement au service de l'humanité, nous devons d'abord comprendre sur quelles ombres elle se construit aujourd'hui.

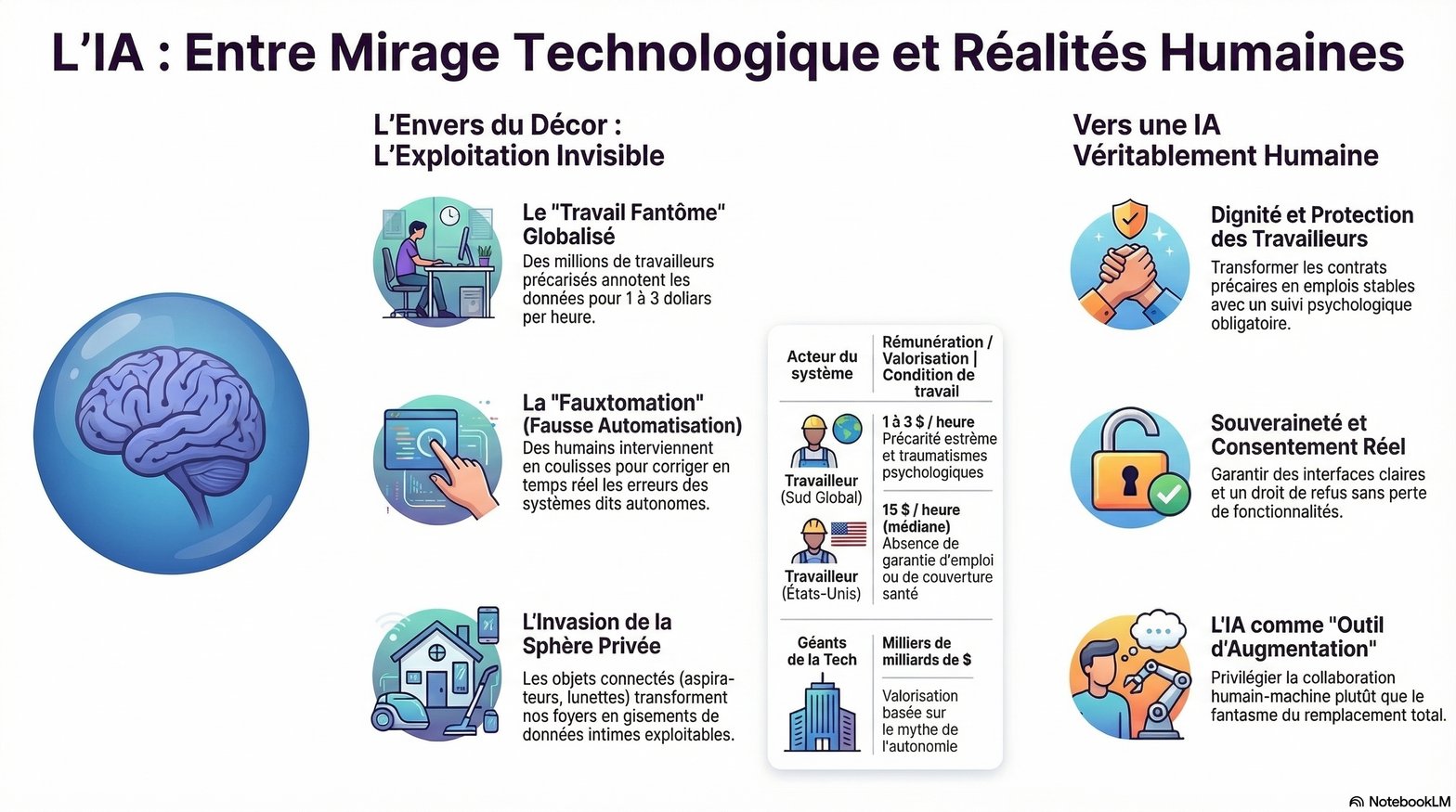

Le travail fantôme

Commençons par dissiper l'illusion la plus pernicieuse à savoir celle d'une IA qui apprendrait seule par magie algorithmique. La réalité est tout autre aujourd’hui et pour quelque temps. Derrière chaque modèle de langage, chaque système de reconnaissance visuelle, chaque assistant vocal se cache ce que les chercheurs nomment pudiquement le "travail fantôme" (ghost work). Il s’agit de millions d'humains dispersés principalement dans les pays du Sud global qui passent leurs journées à annoter des images, étiqueter des textes, transcrire des conversations, corriger des erreurs, ... Sans eux, l'intelligence artificielle est aveugle. Cette armée invisible travaille dans des conditions qui feraient pâlir les pires usines du XIXe siècle. Au Kenya, aux Philippines, en Inde, au Venezuela, des plateformes comme Scale AI ou Sama orchestrent une chaîne d'approvisionnement algorithmique où les tâches les plus ingrates sont externalisées vers les populations les plus vulnérables. La rémunération ? Entre un et trois dollars de l'heure. Parfois moins. Les travailleurs ? Des réfugiés dans les camps de Dadaab ou de Shatila, des populations carcérales mobilisées sous couvert de réhabilitation, des mères de famille cherchant désespérément un complément de revenu. L'IA moderne se construit littéralement sur une extraction néocoloniale du travail précaire.

Pour autant, ce n'est pas seulement une question économique. C'est aussi une question de violence psychologique. Car la nature même de ce travail inflige des traumatismes durables. Les modérateurs de contenu (ces sentinelles chargées d'apprendre à l'IA à distinguer l'acceptable de l'intolérable) sont exposés quotidiennement à des images et vidéos d'une toxicité sidérante : meurtres filmés, pédopornographie, discours de haine, tortures animales et autres plaisirs. Leur mission ? Visionner, catégoriser, étiqueter. Encore et encore. Pour que la machine apprenne à filtrer ce que nos yeux ne devraient jamais voir au détriment de leur santé mentale. Les syndromes de stress post-traumatique sont légion. L'accès à des soins psychologiques ? Quasi inexistant.

Même dans les pays industrialisés, le sort des travailleurs de la donnée n'est guère plus enviable. Aux États-Unis, ils gagnent en médiane quinze dollars de l'heure sans garantie d'emploi et sans couverture santé digne de ce nom. Beaucoup passent des heures à guetter l'apparition d'une tâche sur leur écran, ce temps d'attente n'étant évidemment pas rémunéré. Plus d'un quart d'entre eux dépendent des aides sociales pour survivre. Voilà le paradoxe obscène de notre époque : des entreprises valorisées à des milliers de milliards de dollars bâtissent leur empire sur le dos de travailleurs qui peinent à payer leur loyer. Cette invisibilisation n'est pas accidentelle. Elle est stratégique. L'industrie a besoin de maintenir le mythe de la machine autonome pour justifier ses valorisations astronomiques et préserver l'enchantement technologique. Reconnaître la réalité reviendrait à admettre que l'IA est surtout une redistribution massive et inégalitaire du travail cognitif. Une redistribution où certains pays riches capturent la valeur tandis que les pays pauvres fournissent la sueur.

La fauxtomation

Cette imposture trouve son expression la plus cynique dans ce que certains chercheurs nomment la "fauxtomation" ou plus simplement la fausse automatisation. Partout où l'industrie nous promet des systèmes autonomes, on découvre en grattant la surface des bataillons d'humains travaillant en coulisses pour combler les failles de l'algorithme. Les magasins "sans caisse" ? Des dizaines d'opérateurs vérifient les transactions à distance. Les véhicules "autonomes" ? Des téléopérateurs prêts à reprendre le contrôle à chaque situation ambiguë. Prenons l'exemple des voitures autonomes, censées incarner le summum de l'intelligence artificielle appliquée. Waymo, Tesla, Cruise, tous promettent une conduite sans intervention humaine. La réalité du terrain raconte une autre histoire. Lorsqu'un taxi autonome rencontre un chantier non cartographié, une signalisation contradictoire, un piéton au comportement imprévisible, que se passe-t-il ? Le système transfère immédiatement le contrôle ou du moins l'orientation stratégique à un téléopérateur humain, assis dans un centre de supervision à des centaines de kilomètres. La voiture autonome n'est qu'une coquille maintenue sur la route par un gigantesque filet de sécurité humain invisible.

L'ironie est totale. Non seulement l'humain reste indispensable, mais chaque intervention est précieusement enregistrée, étiquetée, ingérée par le système pour éviter que l'erreur ne se reproduise. Autrement dit, l'IA n'apprend pas seule : elle apprend de ses échecs corrigés par des humains. Le progrès algorithmique n'est que la capitalisation systématique du jugement humain. Cette vérité dérange, car elle renverse le récit dominant. Ce n'est pas la machine qui remplace l'humain. C'est l'humain qui, invisibilisé, continue de porter la machine sur ses épaules.

L'invasion de la sphère privée

Si l'IA se nourrit de labeur humain, elle exige également des volumes exponentiels de données pour ne pas stagner. Or, l'industrie fait face à un problème structurel. Elle a pratiquement épuisé le stock de données textuelles et visuelles publiquement accessibles sur Internet. Ce tarissement provoque ce que les spécialistes nomment le "model collapse" (un phénomène où l'IA, entraînée sur des données synthétiques générées par d'autres IA, perd progressivement en qualité et en cohérence). Pour échapper à cette dégénérescence, les entreprises ont un besoin vital de nouvelles données. De données fraîches. De données humaines. De données intimes.

D'où l'offensive actuelle des objets connectés dans nos espaces les plus privés. L'intimité est devenue le dernier gisement inexploité facile d’accès par comparaison à l’entreprise. Et l'industrie y plonge avec voracité. Les lunettes connectées Ray-Ban de Meta constituent sans doute l'exemple le plus éloquent de cette dérive. Présentées comme de simples accessoires de mode augmentés d'une IA inoffensive, ces lunettes sont en réalité de redoutables outils de surveillance ambiante. Une enquête menée par des journaux suédois en 2025 a révélé que les images capturées par ces dispositifs atterrissaient régulièrement sur les écrans d'annotateurs humains sous-traitants basés à Nairobi. Ce que ces travailleurs kényans voyaient défiler sur leurs écrans ? Des utilisateurs sur leurs toilettes, des personnes se déshabillant dans leur chambre, des scènes de rapports sexuels, des codes de cartes bancaires saisis dans des commerces.

Les promesses commerciales de Meta garantissant une "conception centrée sur la vie privée" s'effondrent face à la réalité technique. Pour que les fonctionnalités d'IA opèrent, les vidéos et fichiers audio doivent transiter par les serveurs de l'entreprise. Une fois là, ils peuvent être, et sont effectivement, examinés par des tiers humains ou algorithmiques. Les filtres d'anonymisation faciale ? Ils échouent régulièrement en cas de faible luminosité. Résultat ? Non seulement le porteur des lunettes est identifiable mais également les personnes filmées à leur insu. Un recours collectif intenté contre Meta décrit à juste titre ce dispositif comme un "conduit de surveillance" exposant les utilisateurs à des risques d'extorsion, de harcèlement et d'atteinte à la dignité.

Pour autant, cette intrusion ne se limite pas aux lunettes connectées. Elle s'étend à tous les recoins de nos foyers. Prenez le pendentif "Friend", vendu comme un compagnon IA pour contrer la solitude (j’y ai consacré un article). Ce collier est équipé d'un microphone perpétuellement activé qui capte chaque son, chaque conversation, chaque interaction y compris celles de personnes tierces n'ayant jamais consenti à cette surveillance acoustique. Comment obtenir le consentement de vos collègues, de vos amis, des passants dans la rue dont les paroles sont ingérées pour entraîner des modèles de langage ? La question n'est même pas posée. En Europe, les régulateurs commencent à s'alarmer de cette violation manifeste du RGPD. Mais le mal est fait car le concept même d'un "assistant émotionnel" permanent normalise l'idée que notre intimité relationnelle peut être “marchandisée”.

Le foyer lui-même, refuge historique de la vie privée, n'est plus épargné. Les robots aspirateurs nouvelle génération, comme les Roombas d'iRobot, ne se contentent plus de nettoyer. Équipés de capteurs LiDAR et de caméras, ils cartographient avec précision l'architecture intérieure de nos maisons. Ils mémorisent où se trouve votre lit, votre cuisine, vos toilettes, vos plantes, ... Cette cartographie résidentielle a une valeur commerciale considérable pour le profilage publicitaire d'où l'intérêt initialement manifesté par Amazon pour acquérir iRobot. Une fuite de données en 2020 a révélé toute la fragilité de ce système : des photographies d'une femme sur ses toilettes, prises par un Roomba en phase de test, ont été diffusées sur des groupes Facebook privés par des annotateurs étrangers payés pour cataloguer ces images. Nos foyers sont devenus des laboratoires de captation où l'intimité n'est plus un droit mais une ressource exploitable.

Le paradoxe de la vie privée

Pourquoi continuons-nous d'adopter ces technologies ? Les études récentes sur nos interactions avec les assistants vocaux et l'IA mettent en évidence ce que les chercheurs nomment le "paradoxe de la vie privée". D'un côté, nous exprimons de vives inquiétudes quant à l'enregistrement constant et au manque de transparence et de l'autre, nous sommes séduits par la commodité, par la fluidité de l'expérience utilisateur et par la promesse d'une vie simplifiée. Cette apparente contradiction n'est pas le fruit du hasard. Elle est le résultat d'une ingénierie comportementale sophistiquée. Les interfaces sont conçues pour maximiser l'adoption tout en minimisant la friction liée aux questions de confidentialité. Les conditions d'utilisation ? Des pavés juridiques illisibles qui noient l'utilisateur sous une avalanche de clauses techniques. Ce que les spécialistes appellent le "policy overload" (la surcharge informationnelle délibérée qui rend impossible toute lecture critique). Les paramètres de confidentialité ? Dispersés, complexes, enfouis dans des menus secondaires. L'option pour supprimer rapidement un enregistrement vocal ou stopper le flux de données vers les serveurs ? Rarement intuitive et surtout souvent absente.

Cette asymétrie est une fonctionnalité et pas un bug. Elle consolide un rapport de pouvoir écrasant entre le citoyen isolé et démuni face à la complexité technique et juridique et la multinationale technologique qui dispose de bataillons d'avocats, de psychologues comportementaux, de designers d'interface, ... Le consentement que nous donnons n'est pas libre. Il est extorqué entre autres par la fatigue, par la nécessité ou encore par l'ingénierie prédatrice des dark patterns. Enfin et surtout, cette capitulation révèle une vérité plus profonde sur notre époque. Nous avons intériorisé l'idée que la surveillance est le prix inévitable de la commodité. Que nos données sont une monnaie d'échange acceptable pour des services "gratuits". Que l'intimité est un luxe d'un autre temps. Cette normalisation progressive de l'inacceptable constitue peut-être le véritable danger car elle est une érosion lente, quotidienne, presque imperceptible de ce qui faisait de nous des sujets libres.

Une autre voie est possible

Regardons ce qui fonctionne. Dans le domaine médical, l'utilisation de l'IA pour prédire les crises de lupus ou de polyarthrite rhumatoïde démontre qu'il est possible de construire des infrastructures de données fiables, sécurisées et éthiquement gouvernées. Les standards OMOP ou FHIR garantissent l'interopérabilité tout en protégeant la confidentialité. Le consentement est explicite, granulaire et révocable. Les données sont anonymisées selon des protocoles rigoureux. Les comités d'éthique supervisent les usages. Ce qui est possible en santé peut l'être ailleurs. La différence tient à la régulation, à la gouvernance et à la volonté politique. Dans le secteur médical, la protection des données personnelles est une obligation légale et éthique ancrée dans des décennies de jurisprudence. Dans le secteur technologique grand public, elle reste largement optionnelle, soumise au bon vouloir des plateformes.

A minima trois axes de transformation s'imposent.

Reconnaître et protéger le travail humain derrière l'IA. Les travailleurs de la donnée ne sont pas des fantômes. Ils sont les architectes invisibles de l'intelligence artificielle. Leur contribution mérite reconnaissance, rémunération juste et protection sociale. Les contrats précaires doivent céder la place à des emplois stables. Les temps d'attente et de formation doivent être rémunérés. L'exposition à des contenus traumatisants doit s'accompagner d'un suivi psychologique obligatoire, financé par l'employeur.

Les géants technologiques ne peuvent continuer à se défausser de leur responsabilité sur des chaînes de sous-traitance opaques. S'ils bénéficient de ce travail, ils doivent en assument les conséquences. La régulation doit créer une obligation de diligence raisonnable couvrant toute la chaîne d'approvisionnement, y compris les travailleurs à l'autre bout du monde. Le modèle du commerce équitable, appliqué aux données et à l'annotation, est une nécessité.

Garantir la souveraineté informationnelle des citoyens. La protection de la vie privée ne peut reposer sur des textes juridiques illisibles et des paramètres obscurs. Elle requiert des interfaces claires, des choix granulaires, des outils de contrôle effectifs et le consentement doit devenir réel plutôt que théorique. Toute utilisation de travailleurs humains pour auditer des enregistrements privés doit faire l'objet d'un consentement distinct et explicite, séparé de l'utilisation du service lui-même. L'utilisateur doit pouvoir refuser cette collecte sans perdre l'accès aux fonctionnalités de base. Les objets connectés domestiques doivent offrir des modes de traitement local (edge computing) qui préservent l'intimité tout en permettant les fonctionnalités intelligentes.

La législation européenne, notamment le RGPD, pose déjà des principes forts comme la minimisation des données, la finalité explicite, le droit à l'effacement et la portabilité. Pour autant, l'application demeure inégale et l'innovation réglementaire doit continuer. Certains plaident pour un droit à l'anonymat numérique permettant d'utiliser des services sans être tracé. D'autres proposent des architectures de données coopératives où les citoyens gardent le contrôle collectif sur l'usage de leurs informations.

Repenser le récit et la finalité de l'IA. Peut-être le problème fondamental réside-t-il dans notre manière de concevoir l'intelligence artificielle. En la présentant comme autonome, nous créons une attente irréaliste et dangereuse. Nous masquons la contribution humaine. Nous évacuons les questions de responsabilité. Nous nourrissons un fantasme de contrôle total qui justifie tous les excès. Si nous assumions pleinement la nature hybride de ces systèmes, nous pourrions les concevoir différemment. Des outils d'augmentation plutôt que de remplacement. Des interfaces de collaboration humain-machine plutôt que de substitution. Des systèmes qui rendent explicite leur dépendance au jugement humain plutôt que de la dissimuler. La valeur de l'IA ne se mesure pas à sa capacité d'autonomie mais à sa capacité d'amplification de nos facultés de discernement, de création et de connexion.

Vers une Intelligence Artificielle Véritablement Humaine

Nous voici à un moment de bascule. L'architecture de l'ombre n'est pas un accident. Elle est le produit de choix économiques, techniques et politiques cohérents qui consiste à maximiser l'extraction de valeur, minimiser les coûts de main-d'œuvre, externaliser les risques et préserver le mythe de l'autonomie machinique. Pour autant, rien de tout cela n'est gravé dans le marbre car d'autres modèles économiques existent, d’autres architectures techniques sont possibles et d'autres régulations peuvent émerger.

La transformation ne viendra pas spontanément de l'industrie. Les incitations économiques poussent dans la direction opposée. Elle requiert à minima une mobilisation citoyenne, une volonté politique, une vigilance réglementaire. Elle suppose d'accepter que certains usages soient simplement incompatibles avec nos valeurs démocratiques. L'enjeu dépasse largement la technologie. Il concerne la dignité du travail à l'ère numérique. Il touche à l'autonomie personnelle face aux systèmes de captation continue. Il interroge notre capacité collective à maintenir des espaces d'intimité, de spontanéité ou encore de liberté dans un monde saturé de capteurs et d'algorithmes.

L'intelligence artificielle n'est ni bonne ni mauvaise. Elle est ce que nous en faisons. Plus précisément, elle est le reflet de nos sociétés. Reconnaître sa nature profondément humaine, tissée de labeur invisible et de données intimes, c'est se donner les moyens de la transformer. Il est temps de repenser l'intelligence artificielle comme un projet collectif dont nous devons reprendre le contrôle. Un projet où la contribution humaine serait reconnue et valorisée. Où la vie privée serait protégée par conception plutôt que sacrifiée par défaut. Où l'innovation technologique servirait l'épanouissement humain plutôt que l'extraction systématique.

C'est une chance unique. Celle de construire une intelligence artificielle véritablement au service de l'intelligence humaine. Une IA qui ne dissimule plus son humanité, mais l'assume pleinement. Une IA qui ne prétend plus à l'autonomie absolue, mais embrasse la collaboration. Une IA qui reconnaît que sa puissance provient de nous et doit donc nous revenir.

Le moment est venu de façonner ce futur. Pas demain. Maintenant et vite !

Si vous souhaitez une synthèse visuelle, il suffit de cliquer ici.

Bonnes métamorphoses et à la semaine prochaine !

Stéphane Amarsy